Abstract

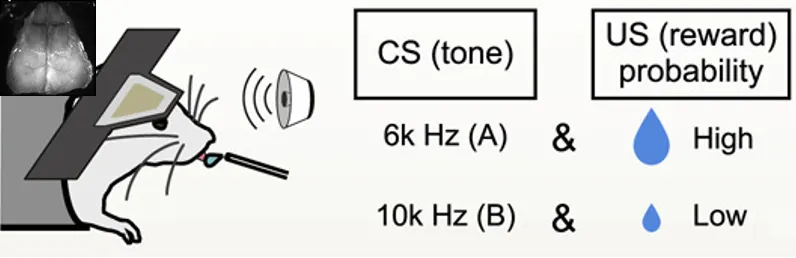

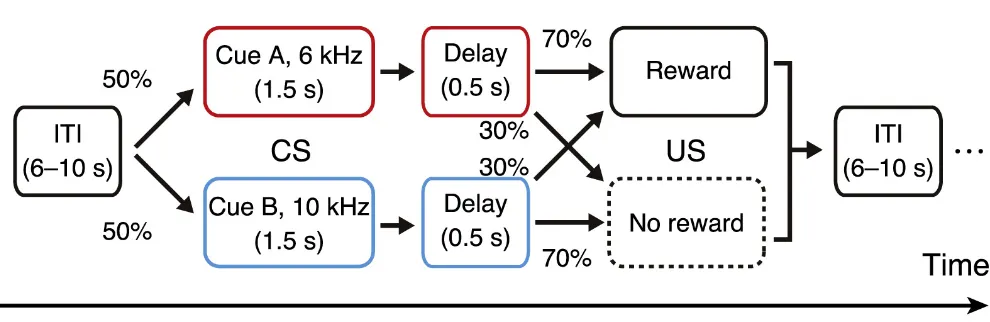

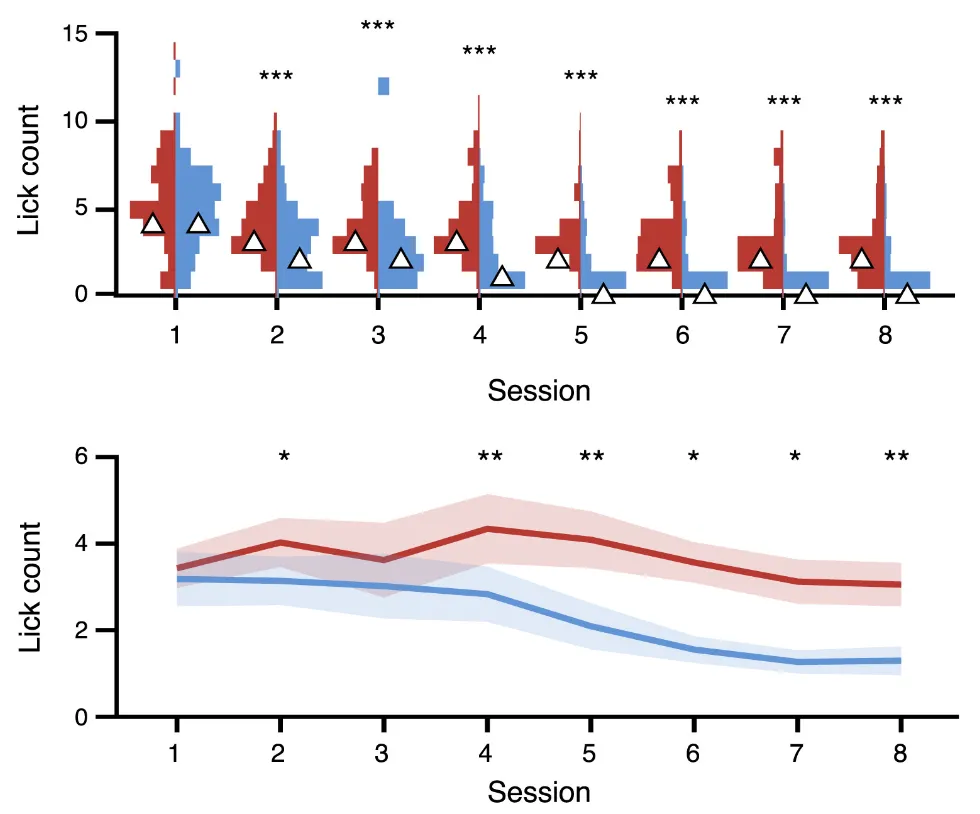

頭部固定マウスに対して古典的条件づけ実験を行った。条件刺激(CS)として6kHzと10kHzの2種類の異なる音を提示し、無条件刺激(US)として6kHzの場合70%の確率で水を報酬として供給、10kHzの場合30%の確率で水を報酬として供給した。この実験を2個体のマウスに対して30分間程度、合計17日間行うことで、古典条件づけの学習過程を記録した。この記録実験において、脳活動をCa2+プローブを使い広視野1光子顕微鏡(Wide-field 1p)により皮質全体の計測を行った。さらにマウスの顔および上半身のビデオデータ(Face Camera, Body Camera)の計測を行った。またマウスの行動データとしてリックや報酬のタイミングの計測した(Behavior data)。

Kondo et. al. 2021では、同様のパラダイムでは古典条件づけの学習後のみの1光子イメージと2光子イメージの神経活動の解析を行った結果、背側前頭皮質内側部(dmFrC)が報酬期待行動における起始点であることが分かった。今回、共有予定のComplete datasetでは計測方法などはKondo et. al. 2021と共通した上で、その学習にいたるまでにどのように脳内の活動が変化していくかを計測した。

Download

現在は東京大学松崎研究室との共同研究、もしくは学術変革領域A「行動変容生物学」内での内部共有を想定した配布を行っています。共有者にはData Descriptionのディレクトリ構造とファイルにアクセスするためのリンクを送付しますので各自でダウンロードしてください。

学術変革領域A「行動変容生物学」後期の公募班の募集のタイミングを目処にCreative Commonsライセンスでの一般公開を予定しています。ただし、予定は変更になる可能性があります。

Data License & Term of Use

Data Description

📁 Directory structure of complete dataset

Complete datasetのリンクから1_Raw, 2_Preprocessed, 3_ROIsegmentationの3つのディレクトリへアクセスできます。このうち、2_Preprocessedは現在未実装です。

├── 1_Raw/ # オリジナル計測データ

│ ├── Behavior/ # リック等の行動データ (.lvm)

│ ├── CaData/ # イメージングデータ (.tif)

│ └── Video/ # Face/Bodyカメラ動画 (.avi)

├── 2_Preprocessed/ # (Coming Soon) 中間処理データ

└── 3_ROIsegmentation/ # 処理済み・ROI抽出済みデータ (.mat)

1_Rawディレクトリではオリジナルのデータに直接アクセスができます。1_Raw以下にはBehavior dataを格納するBehavior, Wide Field 1pを格納するCaData, BodyとFace Cameraを格納するVideoの3つのディレクトリに別れます。それぞれの下には個体番号(RCTg_Pv12とRCTg_Pv13)のディレクトリが存在し、その下には日付ごとに分けられたサブディレクトリがあり、その中にSample datasetのRaw dataで記述されているデータセットがあります。

3_ROIsegmentationディレクトリでは処理後のデータにアクセスできます。フレームレートはすべて30Hzに揃えられており、次の処理を行いました:

- 揺れ補正

- Allen CCFへの合わせ込み

- 左半球のみクリップ

- SVD→トップ24特異値で再構成してデノイズ

- 各ピクセルごと、各時点−15〜+15sの時間窓の10パーセンタイルをFとしてdF/F化

※ プレトレーニング:3セッション(両方の音で100%報酬確率)を含む。3_ROIsegmentation以下には個体番号のディレクトリの下に日付のディレクトリが存在し、その中にmatファイルとしてProcessed dataが格納されています。

📄 File description

マウスの個体番号RCtg_Pv12、RCtg_Pv13の2個体をそれぞれ合計17日間計測した。1日に4セッションの計測を行った。

Raw data

Body Camera Movie

Cam1-180623(日付)_RCtg_Pv12(個体番号).avi

1Session中の実験中のマウスの腹側をカメラにより30Hzで計測した動画データ。

Face Camera Movie

Cam2-180623(日付)_RCtg_Pv12(個体番号).avi

1Session中の実験中のマウスの左側面顔をカメラにより30Hzで計測した動画データ。

Wide Field 1p

180623_RCtg_Pv12*.tif

1Session中の実験中のマウスの上側からの両側大脳皮質のCa2+プローブの励起光を1光子顕微鏡により30Hzで計測したTIFF画像データ。最大2GBの4つのTIFファイルに分かれており、ファイル名後部にX2,X3,X4されたものは、それぞれが時間的に連続した画像ファイルになっている。

Behavior data

180623(日付)_RCtg_Pv12(個体番号)_kondo_5000Hz.lvm

リックや報酬のタイミングを5000Hzで計測した行動データ(ADコンバータを介してアナログ電圧を記録したもの)。MATLABで読み込むためには、以下を利用のこと:lvm-file-import

Segment1.dataは行がフレーム数、列が記録チャンネルの行列になっており、以下の値が格納されている(HIGH=5V, LOW=0Vを意味する)。

| Channel | Signal | Description |

|---|---|---|

| ch.1 | Lick (Raw) | lick sensor(生)、マウスの舌がスパウトに接触しているときHIGH、していないときLOW |

| ch.2 | Reward | 報酬、HIGHになった瞬間にポンプ駆動 |

| ch.3 | Tone Flag | 音、HIGHになっている間、ch.7の音が鳴っている |

| ch.4 | Imaging Sync | イメージングフレーム、HIGHのとき取得。このchのみHIGH=約3V |

| ch.5 | Lick (Binary) | lick sensor(バイナリ)、マウスの舌がスパウトに接触しているとき1、していないとき0 |

| ch.6 | Tone+Delay Flag | 音提示+遅延期間フラグ、2のとき音提示+遅延期間、1のときそれ以外(実際にはこのchは解析に使用していない) |

| ch.7 | Frequency | 音周波数(ch.3がHIGHのとき、このchの音が鳴っている。単位: kHz) |

Analyzed data

stdData_(計測日)_(個体番号).mat

stdData(構造体)

fct3(セル配列):各ROIの神経活動(ROI内ピクセル平均dF/F、全時系列でZスコア化)を、トライアルごとに音の鳴り始めに揃えて取り出したもの。セル配列の要素は『抜き出したトライアル種別』に対応しており、【A+, A-, B+, B-, 実際のトライアル系列】(+/-はそれぞれ報酬有無に対応)となっている。各セル内は3次元配列:フレーム×ROI×トライアル。音オンセットでアラインされており、-6〜8s(フレーム数301)。

flt3(セル配列):fct3と同様だが、神経活動のかわりにリッキング(lick-rateとして連続値化後、Zスコア化)が入っている。

SVDresult(構造体):元画像スタック(処理内容3)に対してSVDを行った結果。各成分ともにデータ量削減のため特異値トップ1000個まで保存。特異値行列Sは対角要素のみ。

videoSVD(構造体):ビデオMotion EnergyをSVDしたもの。FaceMapによって生成。トップ10特異値。

- Smode(セル配列):空間モード。上半身、鼻、ヒゲ、口部分ごと。

- Tmode(セル配列):時間モード。トライアル種別ごと。セル内配列はフレーム×特異時間モード×トライアル×体部位。

※ このフィールドのデータを使うことで、ROI以外の部位(ただし右半球は除く)を任意の特異値までを用いて復元することが可能。

ROIs(配列):ROIマスク。ROI数×Y(取得画像の縦次元)×X(取得画像の横次元)。

Bhv(構造体):行動データから抽出した各イベント生起状態、リッキングなど。

Ds(構造体):実際の行動データ(センサーなどからのアナログ電圧)は5kHzサンプリングされており、イメージングデータのサンプリングレートと異なっている。そのためイメージングの各フレーム取得タイミングを参照して、行動データを30Hzにダウンサンプルしたもの。中身はリッキング(生データ、センサーからのアナログ電圧)、リック頻度(リッキングから計算)、報酬、音A、音B。

Idx(構造体):全トライアルにおける報酬、音A、音Bの提示状態。

TrigF(構造体):フィールド名のイベントオンセット(イメージングフレーム内の位置に対応)。US条件ごとに分けた場合のCSオンセット(A+, B-など)もあり。例えばCueA_nRは音A提示がされ、その後報酬がなかったときの音Aのオンセット。_Rは報酬あり、_nRは報酬なしに対応。

t_type(配列):トライアル種別。ここでいう種別とは、『CSとして提示された音』および『USである報酬の有無』の組み合わせ。1〜4の値がそれぞれ【A+, A-, B+, B-】(+-は報酬有無)に対応。配列内の並びは実際の課題中で起こった順序に対応。

params(構造体):イメージングに関係したパラメータ類。

- d1/d2:イメージング画像(前処理によって左半球のみ抽出)の画素数

- T:イメージングフレーム数

- Frate:サンプリングレート

Results

Method

Processing of Wide-field 1 photon image

1. 前処理パイプライン

- 10個の特徴点を使用し、Allen Common Coordinate Framework v3 (Allen CCF) の上面図に位置合わせ

- アレン CCF から皮質マスクを作成し、大脳皮質外のピクセルの蛍光変化を除外

- 左半球のピクセルのみの活動を利用

- SVD(特異値分解)を計算し、上位24個の特異値から画像を再構成(ノイズ削減)

- 蛍光強度の変化 (ΔF/F) を各フレームの前後 ±15秒の10パーセンタイル値で算出

SVDの出力:空間成分 U(ピクセル×成分)、特異値 S(空間成分×時間成分)、転置された時間成分 VT(成分×フレーム)

2. ROI設定

12個のROI(10×10ピクセル、長方形)を以下の脳領域に設定。定位座標はROIの中心位置。セッションとマウスごとに位置を手動で微調整。

| ROI | Region | AP (mm) | ML (mm) |

|---|---|---|---|

| dmFrC | 背側内側前頭皮質 | +2.8 | 0.8 |

| dlFrC | 背側外側前頭皮質 | +2.5 | 2.0 |

| M1 | 一次運動野 | +1.2 | 1.0 |

| S1FL | 一次体性感覚皮質 前肢領域 | +0.4 | 2.2 |

| S1HL | 一次体性感覚皮質 後肢領域 | -0.5 | 1.5 |

| S1m | 一次体性感覚皮質 口領域 | +1.4 | 3.0 |

| S1n | 一次体性感覚皮質 鼻領域 | 0 | 3.4 |

| S1b | 一次体性感覚皮質 バレル領域 | -1.2 | 3.0 |

| Aud | 一次聴覚皮質 | -2.5 | 4.0 |

| Vis | 一次視覚野 | -4.0 | 2.2 |

| PPC | 後頭頂皮質 | -2.0 | 2.0 |

| RSC | 後大脳皮質 | -2.4 | 0.5 |

3. 信号抽出

各ROIの蛍光強度は含まれるピクセルを平均することで決定。抽出された神経活動はZスコアに変換し、各キュートーンの開始に合わせて調整。

Processing of Face and Body camera image

- 高速度カメラの映像を FaceMap(Stringer et al., 2019)で処理

- 口、鼻、ひげ、上半身の部分を識別し、ROIを設定

- 各ROIの運動エネルギー(フレーム間の絶対差)のSVDを計算

- 空間成分 U と特異値 S から「モーションマスク」を生成

- モーションマスク × 元の時系列データで、分離可能な動きの時系列を算出